Sie sind kaum mehr wegzudenken und man findet sie in Social-Media-Videos, der Lieblingsserie auf Netflix oder bei Filmen im Kino: die Untertitel. Sind sie gut, nehmen wir sie kaum wahr – schlechte hingegen ruinieren unser Videoerlebnis. Im Modul Untertitelung lernen die Studierenden des Bachelors Mehrsprachige Kommunikation, auf was es ankommt.

Autorin: Kyra Jetzer

Wer kennt es nicht: Man schaut eine Serie in ihrer Originalsprache und möchte auch den komplexen Dialogen folgen können, für das koreanische Drama gibt es gar keine Synchronfassung in der eigenen Muttersprache und wenn man im Zug durch Reels scrollt, möchte man lieber auf den Ton verzichten. In genau diesen Situationen machen Untertitel Videos verständlich. Doch nicht nur das, Untertitel bauen Barrieren ab und machen audiovisuelle Medien auch für Menschen mit einer Hörbehinderung zugänglich.

Ob innerhalb einer Sprache oder von einer Sprache in die andere – beim Erstellen von Untertiteln gibt es einige Stolperfallen: Untertitel sollten nicht zu lang sein und eine gewisse Lesegeschwindigkeit – etwa 15 Zeichen pro Sekunde – einhalten. Sie sind zudem angenehmer zu lesen, wenn sie nicht über einen Schnitt gelegt werden und wenn zwischen zwei Untertiteln eine Pause von ein paar Frames gemacht wird. Dennoch sollten Untertitel für mindestens eine Sekunde angezeigt werden und auf keinen Fall zu früh oder zu spät einsetzen. Und zuletzt wollen natürlich Sprichwörter und Redewendungen sinnvoll und Fluchwörter möglichst treffend übersetzt werden.

Oke, nicht alle diese Grundsätze können immer eingehalten werden. Damit Bild, Text und Ton gut miteinander harmonieren, müssen Sprachprofis in jeder Situation abwägen, was wann wichtiger ist.

So kommt der Text ins Video

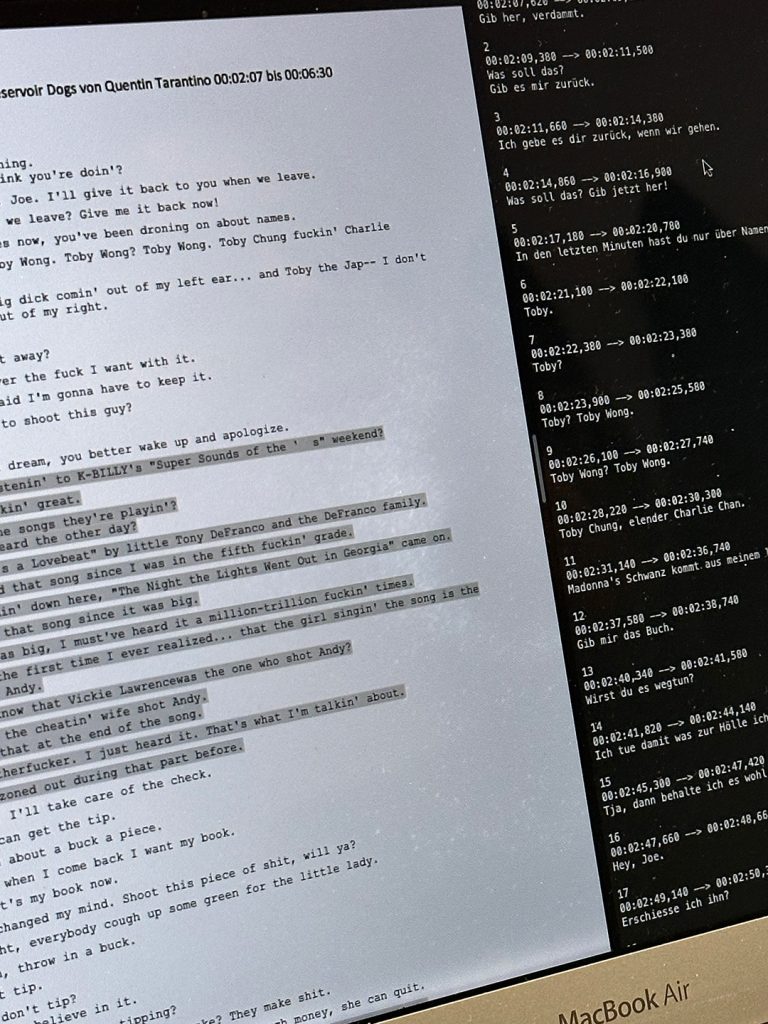

Die Grundlage eines jeden Untertitels ist das Transkript. Während dieses bei Filmen oder Serien meist schon besteht und mitgeliefert wird, kann es vor allem bei Corporate oder Social-Media-Videos öfters fehlen. Ein geschultes Auge und Ohr oder ein praktisches Speech-to-Text-Tool sind daher von Vorteil. Mittlerweile funktionieren diese übrigens auch sehr gut auf Schweizerdeutsch. Ist das Gesprochene erstmal transkribiert, wird der Text noch einmal unter die Lupe genommen und angepasst. Unter anderem an die schriftliche Sprache oder die Lesegeschwindigkeit. Vor allem bei diesem Schritt übertrumpft die von Menschen erstellte Untertitelung die maschinelle. Einerseits durch ihr Feingefühl für Sprache und anderseits durch die Fähigkeit, individuell auf Einschränkungen und Eigenheiten einzugehen.

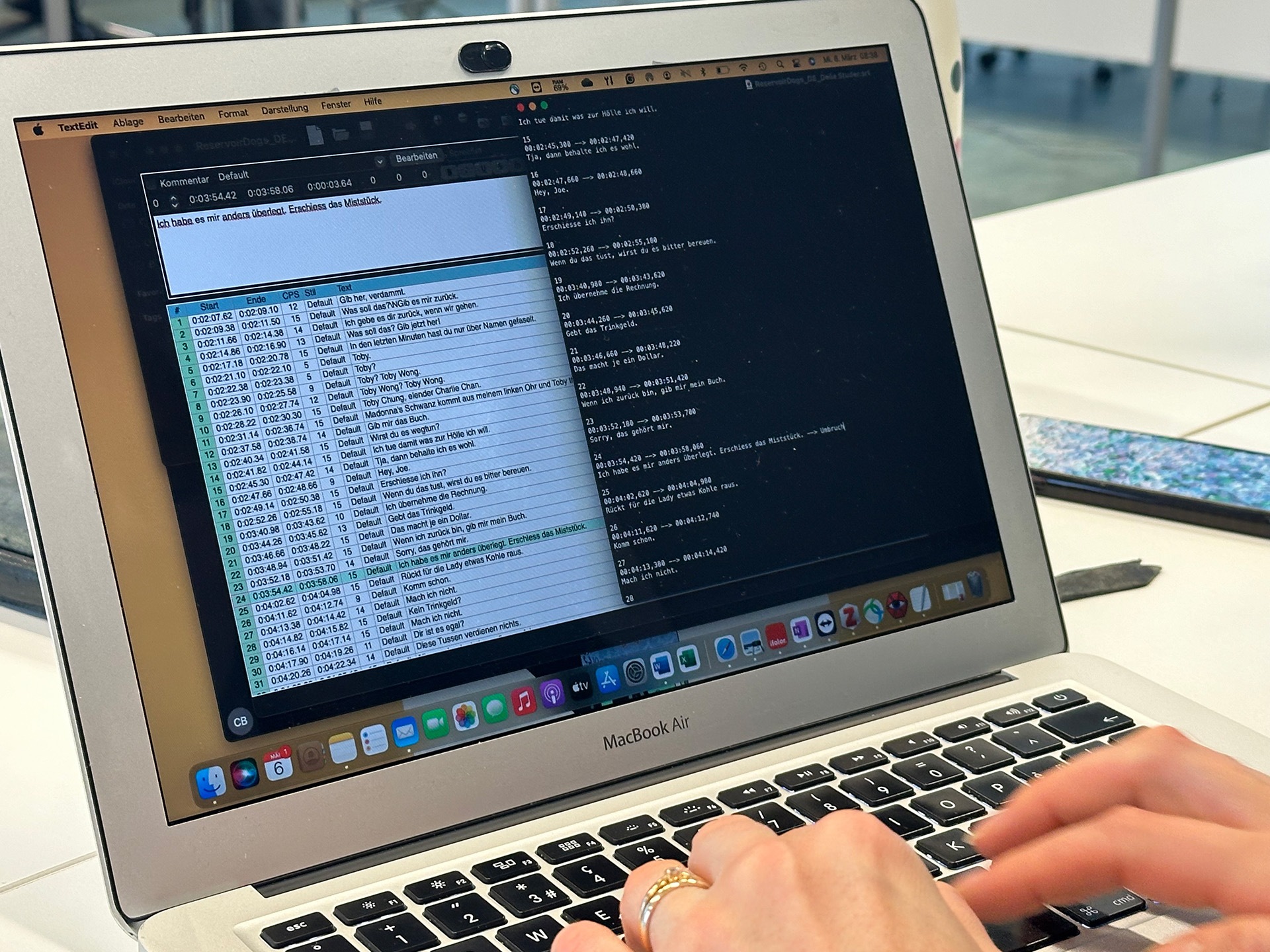

Steht der Text schliesslich, geht es um die konkrete Erstellung der Untertitel – dem sogenannten Spotting. Hierbei wird in einer Untertitelungs-Software genau festgelegt, wann und wie lange ein Untertitel eingeblendet wird. Unter Berücksichtigung von Zeichenbeschränkungen, Zeilenumbrüchen und weiteren Vorgaben wird der gesprochene Text schliesslich auf die einzelnen Untertitel aufgeteilt, damit er einfach gelesen und verstanden werden kann.

Im Idealfall gibt es keine oder nur eine leichte Diskrepanz zwischen Gehörtem und Gelesenem. Gut umsetzbar ist dies, wenn Untertitel und die Audiodatei in derselben Sprache sind und aufgrund eines schriftlichen Skripts erstellt wurden. Spricht die Person im Video frei, ist eine Diskrepanz jedoch kaum verhinderbar. Um Inhalt, Emotionen, Humor und sprachliche sowie kulturelle Feinheiten akkurat in eine andere Sprache zu übersetzen, braucht es besonderes linguistisches Feingefühl. Da es für umgangssprachliche Ausdrücke oder Wortspiele oft keine direkte Übersetzung gibt, müssen die Untertitler:innen geeignete Lösungen finden, die dieselbe Wirkung erzielen. Eine gute Untertitelung ist eben nicht nur das Einfügen von Text. Es geht darum, die Charaktere widerzuspiegeln, eine Stimmung aufzufangen und die Essenz des Dialogs zu wahren.

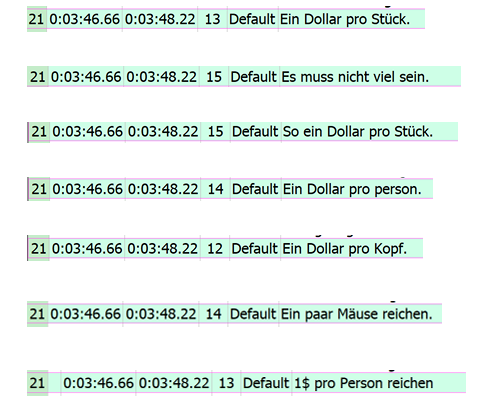

Von Frame zu Frame

Die richtige Formulierung zum passenden Zeitpunkt in der optimalen Länge zu finden ist eine Kunst, die gelernt, trainiert und bei jedem gesprochenen Text neu angewendet werden muss. Für die Studierenden im Bachelor Mehrsprachige Kommunikation bedeutet dies, Reduktion, Segmentierung und den Wechsel von mündlicher zu schriftlicher Sprache an Ausschnitten aus «Reservoir Dogs», «Friends» oder «Wallace & Grommit» zu üben. In der Vorlesung analysiert Peter Jud dann die verschiedenen Formulierungen mit den Studierenden. Welche Varianten sind angenehmer zu lesen oder welche sind der Originalaussage am nächsten. Beim Vergleich der erledigten Aufgaben zeigt sich gut, wie unterschiedlich Untertitel von Person zu Person ausfallen können. So setzt eine Studentin den Zeilenumbruch ein Wort früher als ein anderer Student und die Vorschläge für die Übersetzung der Aussage «Should be about a buck a piece.» fallen ebenso unterschiedlich aus. Ein einziges «richtig» gibt es dabei nicht.